基于单位切线模糊运动基元的模仿学习与遥操作共享控制

在机器人技术中,轨迹生成对于实现机器人精确灵巧的动作起着至关重要的作用。从演示中学习(Learning from Demonstration,LfD),也称为模仿学习,即机器人通过模仿专家演示获得技能,是机器人获取人类操作技能的关键。为进一步提高轨迹模仿学习的效率泛化性,课题组提出一种新型的基于单位切线模糊运动原语(Unit Tangent Fuzzy Movement Primitives, UTFMP)的模仿学习及共享控制框架。相关成果于2024年8月以“lmitation Learning and Teleoperation Shared Control With Unit Tangent Fuzzy Movement Primitives”为题,在线发表于高水平学术期刊《IEEE Transactions on Fuzzy Systems》(2024 IF:10.7)。

作者信息:温浩博士生、付雯硕士、陈武硕士、郇佳乐博士生、李长胜副教授、段星光教授

联系方式:hao.wen@bit.edu.cn, lics@bit.edu.cn

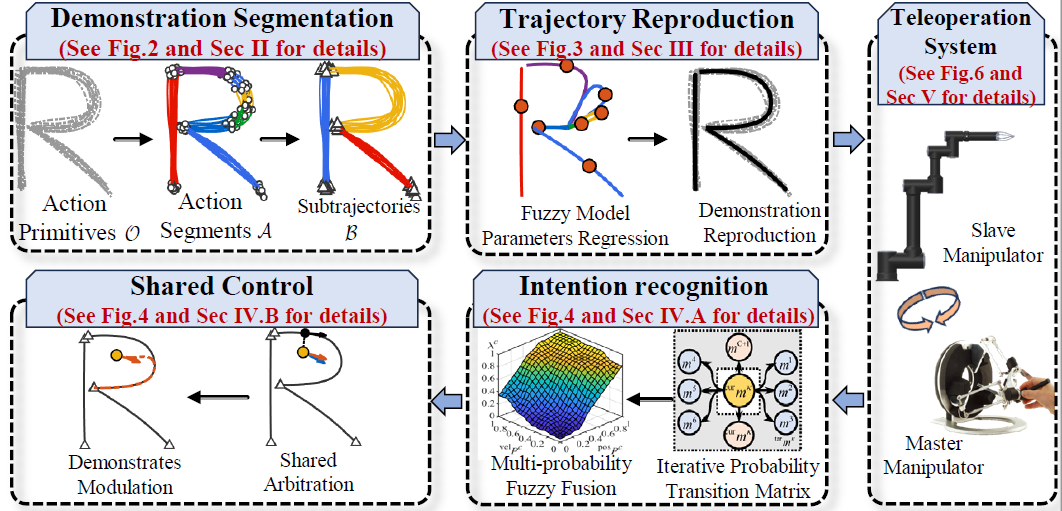

本文介绍了一种基于单位切线模糊运动原语(UTFMP)的模仿学习方法和共享控制框架,如图1所示。该共享控制框架包括有:无监督演示分割、模仿学习、轨迹调制、意图预测和共享仲裁。

图 1 系统整体框架图

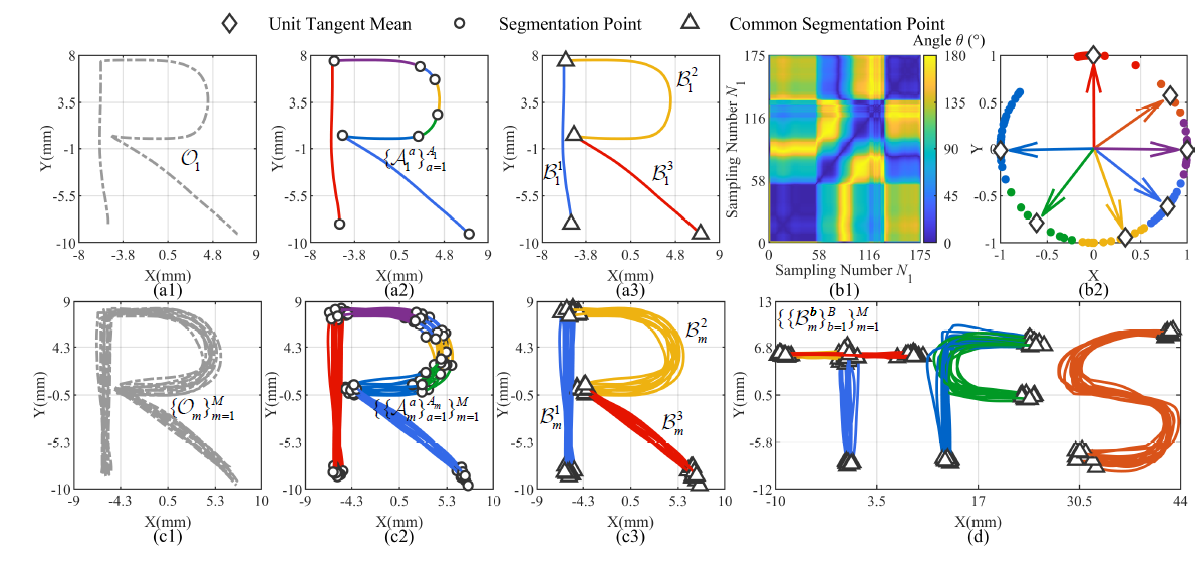

为了增强对特定技能学习的泛化能力且减少过拟合,通常需要多个专家演示作为输入。我们发现单位切向量,是分割和聚类中动作原语的一种理想评判标准。于是如图2所示,我们设计了基于修改K-Means聚类算法与动态时间规整的方法以实现轨迹的无监督分割。

图 2 无监督轨迹分割。(a1)-(a3)和(c1)-(c3),分别表示单次演示“R”和单次演示“R”的动作原语集、公共动作段集、分段子轨迹集。(b1)和(b2)是单位切向量的格拉姆矩阵图和聚类信息;(d)是带有断点的多演示(“TFS”)的轨迹分割示例。

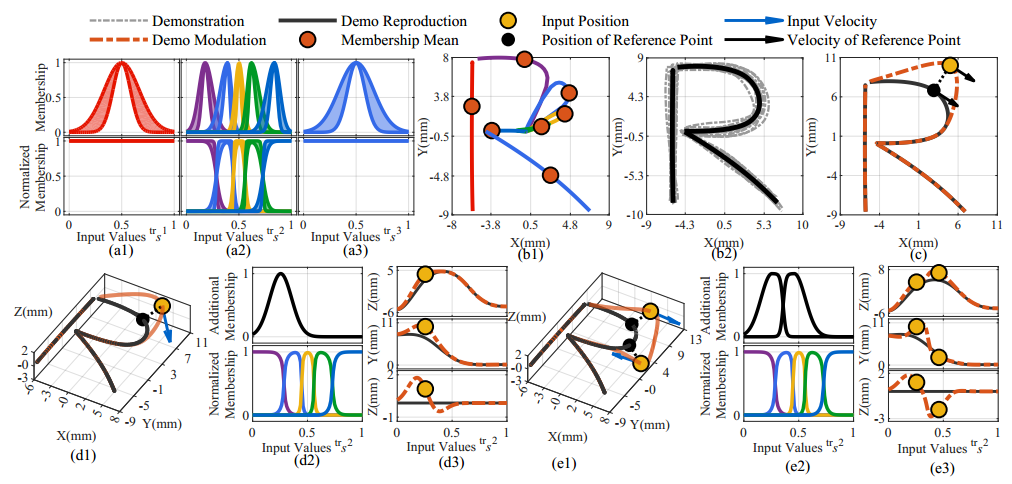

本方法使用基于UTFMP获得的无监督演示分段结果,作为轨迹模糊模仿学习的隶属函数的参考,并采用2型模糊模型来处理多个演示中分段子轨迹的不确定性。此外,我们提出了一种支持基于时间、位置、速度等输入的实时轨迹调制(如图3所示)。

图 3 UTFMP的模仿学习与调制。(a)表示“R”的隶属度函数和归一化隶属度函数; (b1)表示分段子轨迹的再现和“R”的轨迹重建。(c)(d)(e)分别表示不同输入的轨迹调制。

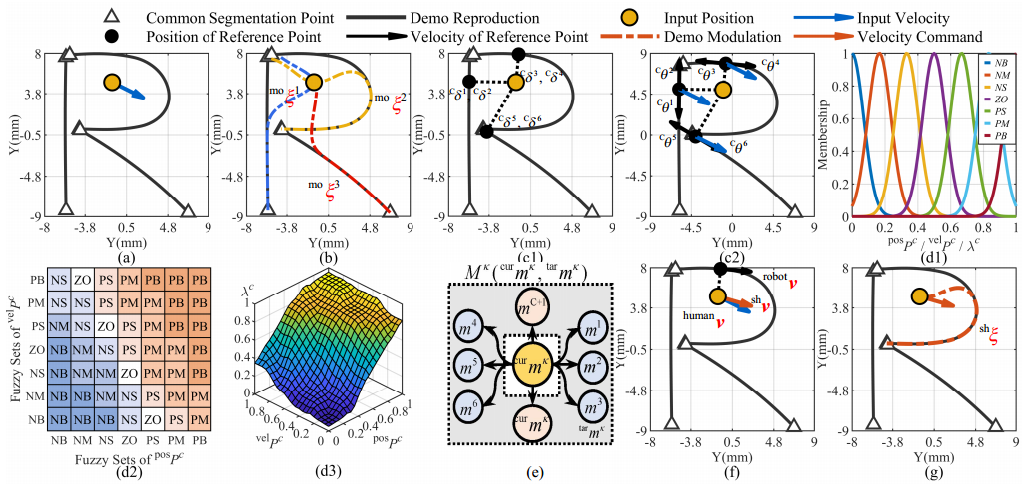

然后,我们建立了一种基于UTFMP的共享控制框架(如图4所示),以扩展其应用。该框架包括通过模糊融合的意图识别和用于识别操作人员意图的马尔可夫转移矩阵,以及用于集成操作人员和机器人代理操作的共享仲裁。

图4 基于UTFMP的意图识别和共享控制。(a)描述了以人类输入速度和机器人当前位置为输入信息的调制;(b)表示以不同的分割子轨迹调制得到的轨迹;(c)表示基于位置与速度的概率模型输出图;(d1)(d2)(d3)分别包含模糊融合隶属函数、模糊规则、模糊融合输出;(e)为马尔可夫状态转移函数图;(f)描述了获得shv的共享仲裁;(g)显示了以SHV为{mo}的调制。

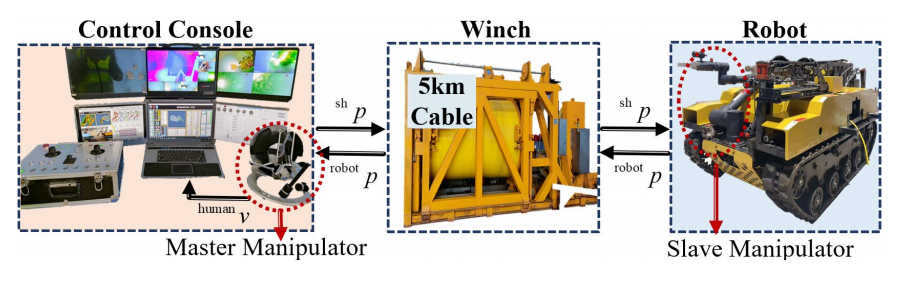

最终我们通过仿真实验验证了UTFMP在演示分割、模仿学习和调制方面的有效性。并搭建了一套如图5所示的5km遥操作机器人实验平台来进行模仿学习与共享控制实验验证,与传统速度控制相比,采用该共享控制方法的轨迹平滑度和精度分别提高了24.38%和9.48%,控制时间减少了16.56%。

图 5 一种遥操作机器人实验平台